当数据中心开始「喝电」:一场关于电力、技术与选择的对话

你有没有想过,你手机里那个能陪你聊天的AI,它背后需要多少电来支撑?说出来可能会吓你一跳——可能比一栋办公楼的用电量还大。这不是危言耸听,而是正在发生的现实。

一个正在变得棘手的问题

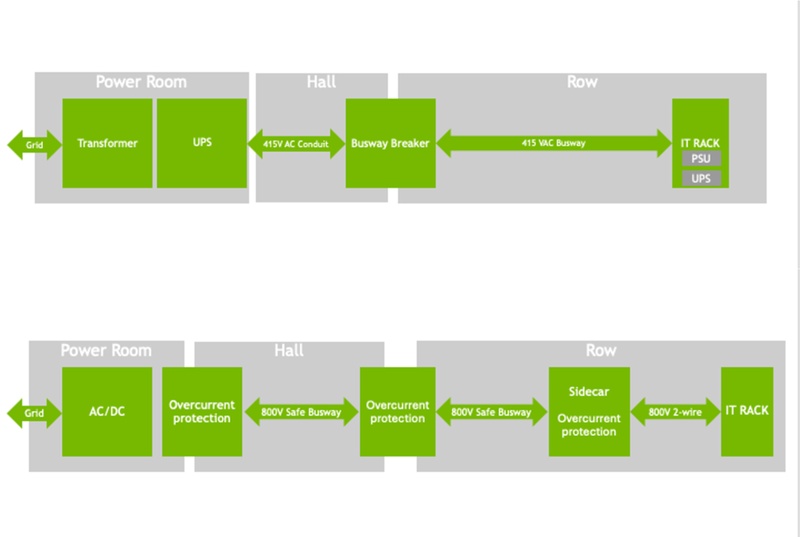

想象一下,十年前的数据中心,一个机架的功率大约是10到15千瓦。那时候的供电方案虽然称不上完美,但至少还能应付。可现在呢?NVIDIA的GB200NVL72机架功率已经逼近120千瓦,而到2027年,单机架500千瓦到1兆瓦的目标正在变成现实。这种功率密度的爆发式增长,正在把传统交流配电系统逼到墙角。

为什么会这样?我给你打个比方。我们都知道,电流通过导线时会发热,电流越大,发热越厉害。在传统架构下,把电压从发电厂的高压降到服务器能用的低压,需要经过好几级转换,每一级都在损失能量、产生热量。一个机架里有二十台服务器,每台服务器都在自己内部完成交流到直流的转换,这些转换产生的热量全都散在机架里。功率小的时候还好,功率大了之后,冷却系统就成了最大的瓶颈。

更麻烦的是,随着功率增加,导线需要变得更粗才能承载更大的电流。你知道54V配电要承载1兆瓦负载,需要多粗的铜排吗?答案是每机架200公斤铜。如果建一座1吉瓦的数据中心,光机架内的铜排就需要20万公斤。这不是设计问题,这是物理定律在说话。

一百多年前的「冤案」要翻了?

有意思的是,这个看起来无解的问题,答案其实藏在140年前的一场失败里。1880年代,爱迪生和威斯汀豪斯有过一场著名的「电流战争」。爱迪生押注直流电,威斯汀豪斯押注交流电。最后交流电赢了,原因很简单:交流电可以用变压器方便地改变电压,长距离输电损耗低。爱迪生输了,此后的130多年里,交流电统治了几乎所有用电场景。

但故事没有结束。今天,当我们需要在数据中心内部配送电力时,直流电的优势反而回来了。原因同样简单:直流电的电压变换不需要复杂的变压器,而且直接配送到负载侧,省去了多级转换的损耗。

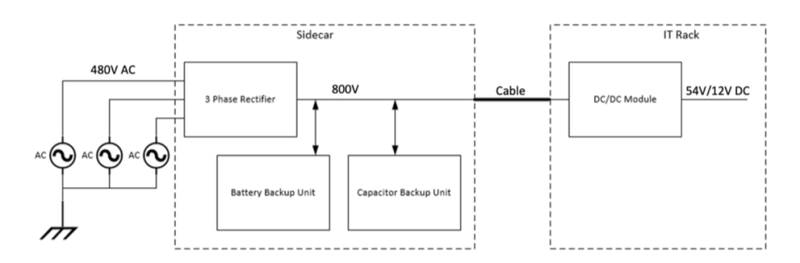

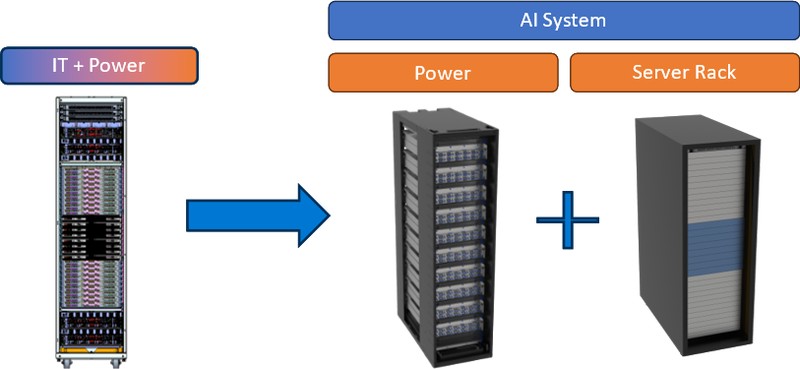

这不,NVIDIA在2025年正式推出了800V高压直流方案。800V意味着什么?意味着同等功率下,电流可以降低约15倍,铜材用量跟着降一个数量级。更重要的是,把AC-DC转换集中到机架外部的大型整流设备中完成,然后直接用800V直流配送到机架,废热产生在机房之外,不再加重冷却系统的负担。

朋友圈里的新动静

消息一出来,整个产业链都动了起来。英飞凌、德州仪器、意法半导体、台达、维谛、施耐德、伊顿……这些平时不太出现在科技头条的公司,突然就成了香饽饽。他们的方案虽然各有特色,但目标一致:让800V直流从纸面走到现实。

有意思的是,中国在这个故事里其实早就走在了前面。早在2007年,江苏电信就开始试点240V高压直流。阿里、腾讯、百度这些互联网巨头在自建数据中心中广泛采用HVDC方案。2019年阿里巴巴推出的「巴拿马电源」,更是把从中压10千伏交流一步直转240V直流的效率做到了97.5%。截至2024年,台达销售的巴拿马电源在线运行数量已超过500套。

当然,现在的主流还是240V,与NVIDIA推动的800V还有代际差距。2025年8月,台达联合中讯邮电咨询设计院发布了国内首部《数据中心800V直流供电技术白皮书》。2026年初,字节跳动在最新一轮AI数据中心招标中首次引入800VHVDC方案,计划将高压直流在新建园区中的渗透率提升至30%到40%。

接下来会发生什么

2026年3月的GTC大会上,800V电源模块、母排、sidecar原型机已经摆上了展台。NVIDIA在技术博客里写道:「我们不只是在造更快的GPU,而是在重新设计整个供电堆栈。」这句话背后的含义是:AI芯片对电力的需求,已经大到必须从基础设施层面重新思考问题的地步。

当然,变革从来不会一帆风顺。运营关键基础设施的人天然厌恶风险,交流电用了一百多年,大家知道怎么部署、怎么维护、怎么保证安全。一旦切换到直流,一切都是新的,需要重新培训、重新建立规范。客户的通常做法是把新设备拿回实验室反复测试,确认满足需求后才部署到生产环境。这听起来保守,但完全合理。

不过趋势已经不可逆转。当功率密度继续攀升,当物理定律不断发出警告,行业终将选择那条被验证过的路。140年前爱迪生输掉的那场战争,正在以另一种形式重新开局。只是这一次,裁判不是华尔街的资本,而是越来越渴电的AI芯片。