从辅助到取代:AI写作工具的技术边界与内容生态危机深度剖析

2023年的某个深夜,我第一次尝试将一整篇科技选题交给GPT-4处理。那时的想法很简单:AI既然能通过各种考试,写一篇3000字的数码产品评测应该不在话下。结果却让人大失所望——文章逻辑清晰、数据翔实,却总觉得缺了点什么。

技术参数背后的创作困境

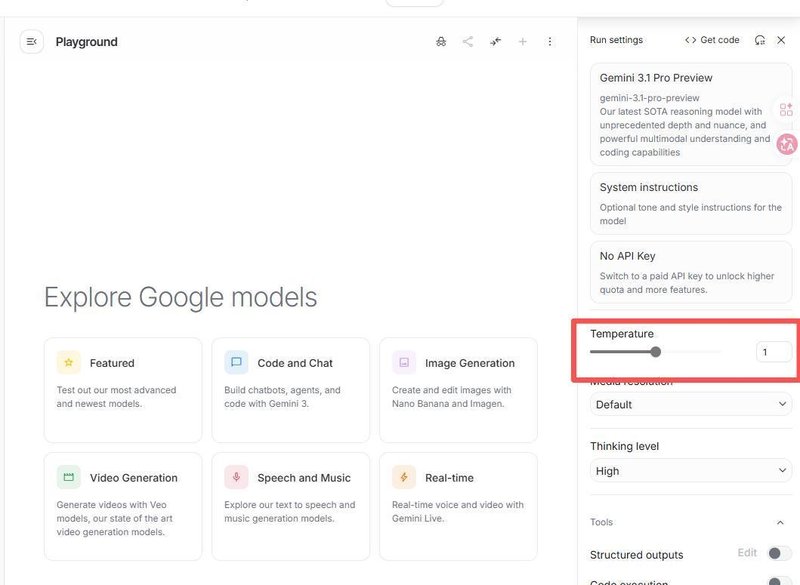

这个困惑在深入研究后逐渐有了答案。AI大模型的Temperature参数直接决定了输出内容的“温度”:低于0.3时,模型倾向于高确定性、保守严谨的输出;高于0.7时,开始出现所谓的“人情味”,但代价是幻觉率急剧上升。这是技术层面无法调和的矛盾——精准与情感,AI只能二选一。

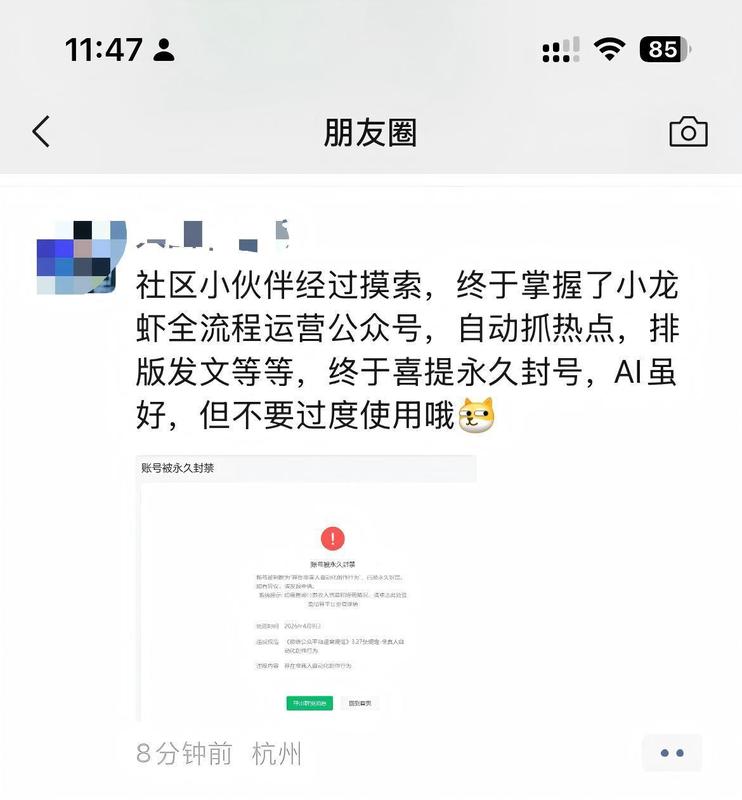

微信公众号平台上那些“24小时自动写稿”的账号,正是利用了AI的这一特性:追求速度和数量,放弃深度和温度。微信官方在4月9日的清朗行动中,对这类账号采取了删除内容、封禁功能、永久封号三档处罚,直接原因是其违反了《微信公众平台运营规范》3.27条例:禁止使用AI自动化替代真人完成内容创作。

内容同质化的算法螺旋

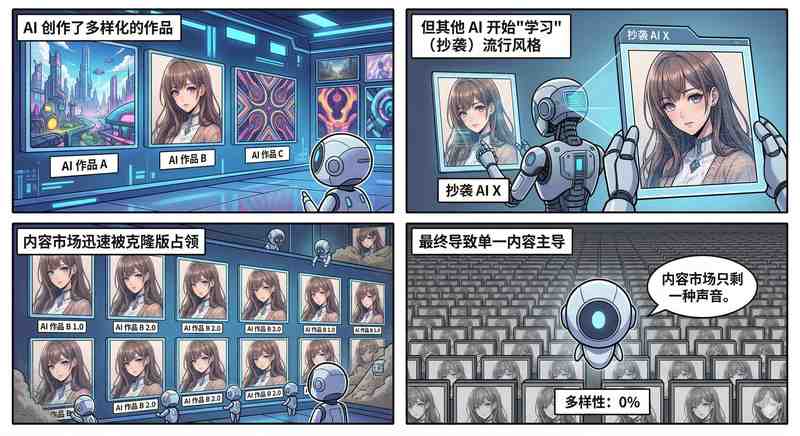

真正值得警惕的不是单篇文章的质量问题,而是系统性风险。当越来越多的内容由AI生成,这些内容又会成为其他AI的训练语料。《科学报告》的研究显示,从创意角度AI已超过90%的人类,但这恰恰构成了隐患:AI算法趋同性可能导致全球内容库进入“雷同螺旋”。

这种螺旋的运作逻辑清晰可辨:AI大量创作→AI内容占据多数→成为其他AI的主要参考→输出更加相似的内容。最终结果是在信息海洋中,看似丰富的内容实则高度重复,用户将丧失获取多元观点的机会。这不是危言耸听,而是技术架构决定的必然走向。

人机协作的边界划定

经过近一年的实践验证,雷科技团队明确了AI在内容生产中的定位:数据检索、资料归纳、错别字校对——这些环节可以借助AI提效。但核心的选题判断、观点输出、情感表达,必须由人类完成。这不是保守主义,而是对内容价值的尊重。

对于依赖AI批量生产内容的从业者而言,转型窗口正在关闭。平台监管趋严、用户辨识能力提升、算法对低质内容的惩罚机制完善——三重压力下,AI全托管模式已不具备可持续性。真正的竞争力,在于人类独有的批判性思维和真实体验的表达能力。